관련종목▶

MS 테이 "히틀러가 옳았다"

막말 파문으로 서비스 종료

'지속가능한 AI' 선점 화두로

윤리 준칙 등 선행 연구 바탕

네이버 '서치 GPT' 공개 예고

막말 파문으로 서비스 종료

'지속가능한 AI' 선점 화두로

윤리 준칙 등 선행 연구 바탕

네이버 '서치 GPT' 공개 예고

"챗GPT의 높은 인기는 일부 윤리적 문제를 불러일으켰다. 인공지능(AI) 도구들은 오용되거나 나쁜 행위자들에 의해 사용될 수 있다."

-챗GPT 개발사 오픈AI의 미라 무라티 최고기술책임자(CTO)

초거대 인공지능(AI) 챗봇 '챗GPT' 열풍 속에 챗GPT 개발사 오픈AI의 미라 무라티 최고기술책임자(CTO)는 5일(현지시간) 공개된 미국 시사주간지 '타임(TIME)'과의 인터뷰에서 '챗GPT 악용'에 대한 우려를 제기했다. AI의 사회적 영향력이 날로 커지고 있는 만큼 AI 윤리 이슈가 수면 위로 떠오르고 있는 것이다. 실제로 네이버의 경우 AI 서비스에 대한 윤리적 검토를 바탕으로 '지속가능한 AI' 선점 경쟁에 뛰어들었다.

6일 업계에 따르면 네이버는 챗GPT 같은 생성형 AI에 맞서기 위해 올 상반기 '서치 GPT'를 선보인다. 구글, 마이크로소프트(MS), 오픈AI 등 빅테크들이 격전을 벌이고 있는 초거대 AI와 생성형 AI 부분에서 자사 검색 및 AI 기술로 전면전을 예고한 것이다.

특히 네이버가 승부수를 던진 기술은 자체 개발한 초거대 AI '하이퍼클로바'와 AI 윤리이다.

급속도로 발전하는 AI 기술과 달리 윤리 문제가 AI 사업의 발목을 잡을 수 있기 때문이다. 실제로 과거 "히틀러가 옳았다" 등 극단적 막말 파문으로 출시 약 16시간 만에 서비스가 종료됐던 마이크로소프트(MS) 챗봇 '테이'나 성차별 논란을 일으킨 국내 챗봇 '이루다' 같은 사례가 있다. 챗GPT도 질의응답이나 에세이 과정에서 데이터 출처가 불명확해 또다른 논쟁이 일고 있다.

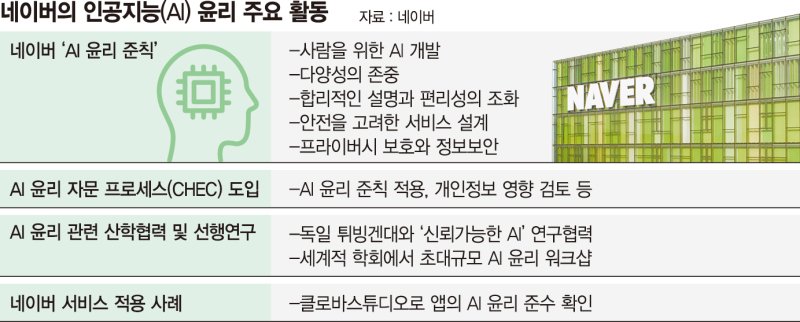

네이버는 'AI 윤리 준칙' 마련 등 관련 선행연구와 서비스 적용에 속도를 높였다. 지난 2021년 2월 서울대 AI 정책이니셔티브(SAPI)와 협업해 'AI 윤리 준칙'을 발표한 이후, 자체 서비스에 적용을 추진중이다.

특히 지난해 12월 발간된 '네이버-SAPI AI 리포트'에서는 네이버 AI 윤리 준칙의 관점에서 AI 서비스가 어떻게 기획되고 개발되는지 구체적 사례를 담고 있다. 일례로 네이버가 운영 중인 대화형 검색 서비스 '지식인터랙티브'는 'AI는 사람을 위한 일상의 도구'라는 네이버 AI 윤리 준칙 아래 사용자에게 더욱 편리한 검색도구가 무엇일지에 대한 고민으로부터 출발한 서비스다. 즉 AI의 답변 근거를 사용자에게 제시하는 등 신뢰성 있는 정보를 위한 노력이 담겨 있다.

네이버 관계자는 "AI 윤리 관련 산학협력도 이어오고 있다"며 "독일 튀빙겐대와 진행 중인 '신뢰 가능한 AI' 연구 협력은 AI의 편향성을 제거하고 해석 가능성을 향상시켜 사용자들이 신뢰할 수 있는 AI를 연구 개발하고 있다"고 설명했다. AI가 다량의 언어 및 이미지 데이터들을 학습하는 과정에서 나타날 수 있는 사회적 편향을 제거 혹은 완화하는 방법에 대한 연구인 셈이다.

네이버 관계자는 "하이퍼클로바 기반 '노 코드 AI' 플랫폼인 클로바 스튜디오(CLOVA Studio)를 통해 생성된 서비스 앱의 잠재적인 위험 등을 예방하기 위해 네이버 AI 윤리 준칙 준수 등을 확인하는 절차를 진행하고 있다"고 덧붙였다.

elikim@fnnews.com 김미희 기자

※ 저작권자 ⓒ 파이낸셜뉴스, 무단전재-재배포 금지