개인정보위, ‘AI시대 안전한 개인정보활용 정책방향’

AI 단계별 개인정보 처리원칙 제시..법령해석-컨설팅

AI 디지털 국제규범 형성 위해 글로벌 협력체계 구축

[파이낸셜뉴스] 정부가 글로벌 규범을 선도할 수 있는 인공지능(AI) 개인정보 규율체계 확립에 나선다. AI 관련 디지털 국제규범 형성을 위해 오는 2025년 글로벌프라이버시총회(GPA)를 유치한다는 목표다. 동시에 오픈AI, 구글, 메타 등 글로벌 빅테크와 정책 소통을 강화하는 한편 AI 관련 사항을 전담하는 원스톱 창구인 ‘(가칭)AI 프라이버시팀’을 오는 10월 중 신설할 계획이다.

AI 단계별 개인정보 처리원칙 제시..법령해석-컨설팅

AI 디지털 국제규범 형성 위해 글로벌 협력체계 구축

개인정보보호위원회(개인정보위)는 3일 정부서울청사 브리핑을 통해서 이 같은 내용을 담은 ‘인공지능 시대 안전한 개인정보 활용 정책방향’을 발표했다.

개인정보위 고학수 위원장(사진)은 “이제 AI는 전 세계, 모든 산업에서 기반 기술로서 역할을 하고 있는 만큼, 데이터를 어떻게 안전하게 활용할 수 있을지에 대한 새로운 디지털 질서 정립이 필요한 시점”이라며 “AI에 있어 무조건적 ‘제로 리스크(zero risk)’를 추구하기보다는 프라이버시 침해 최소화를 위한 실천적 노력을 경주하는 것이 더욱 중요하다”고 강조했다.

즉 오픈AI의 ‘챗GPT’ 등장 이후 AI 기술 중점이 대규모언어모델(LLM)을 기반으로 한 생성형 AI로 이동하고, 공개된 정보를 활용하거나 정보주체가 예측하지 못한 방식으로 데이터가 처리되는 경우가 늘고 있는 만큼, 프라이버시 침해 위험은 최소화하면서 AI 혁신 생태계 발전에 꼭 필요한 데이터는 안전하게 활용할 수 있도록 관련 정책이 마련돼야 한다는 게 개인정보위 설명이다.

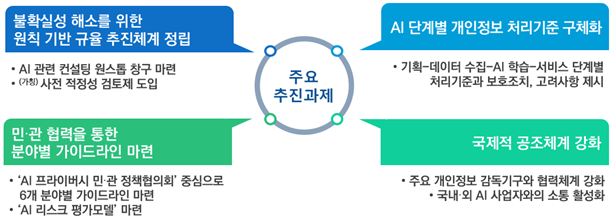

이른바 ‘AI 환경’에서 현행 ‘개인정보 보호법’을 어떻게 해석·적용할 수 있을지에 대한 준칙을 제시하는 한편, 구체적인 세부사항에 대해서는 향후 정부와 민간이 협력하여 규율체계를 공동 설계해 나가는 청사진을 제시하는 데 방점이 찍혔다.

특히 오는 10월 신설되는 ‘AI 프라이버시팀’은 AI 모델 및 서비스를 개발·제공하는 사업자와 소통창구를 마련, 개인정보 처리 적법성과 안전성 등에 대한 법령해석을 지원한다. 또 ‘(가칭)사전 적정성 검토제’도 연내 도입된다. 즉 사업자가 요청하면 비즈니스 환경을 분석하여 ‘개인정보 보호법’을 준수할 수 있도록 적용방안을 함께 마련하고, 이에 따른 사업자의 이행결과에 대해 개인정보위가 적정하다고 판단한 사안에 대해서는 행정처분을 하지 않는 제도이다.

AI 개발 및 서비스 단계별 개인정보 처리기준, 보호조치, 고려사항 등도 제시됐다. △AI 개발 및 서비스 기획 △데이터 수집 △AI 학습 △서비스 제공 등 각 단계별로 개인정보를 어떠한 원칙과 기준에 입각해 처리할 수 있는지에 대해 구체화된 것. 이때 AI 학습 단계에서는 개인정보를 가명처리한 뒤, 별도 동의 없이 AI 연구개발이 가능하도록 했다.

개인정보위는 AI 기업 및 개발자를 비롯해 학계와 법조계, 시민단체 등 민관이 함께 논의할 수 있는 ‘AI 프라이버시 민관 정책협의회(민관 협의회)’도 오는 10월 구성할 예정이다. 민관 협의회는 분야별 AI 환경에서의 데이터 처리기준 등을 공동 작업해 발표할 계획이다. 또 개인정보보호 강화기술(Privacy Enhancing Technology, PET)이 활성화될 수 있도록 연구개발(R&D)을 확대하고 관련된 가이드라인도 마련한다.

이밖에 AI 리스크 수준에 따라 규제 설계가 가능할 수 있도록 위험성에 대해 구체적으로 판단할 수 있는 ‘AI 리스크 평가모델’도 마련한다. 개인정보위는 “규제 샌드박스를 활용해 AI 분야 사례를 축적하고 이를 바탕으로 운영현황과 위험요인 등을 분석해 리스크를 식별 및 평가할 수 있는 체계를 2025년까지 지속적으로 구축해 나갈 계획이다”라고 전했다.

elikim@fnnews.com 김미희 기자

※ 저작권자 ⓒ 파이낸셜뉴스, 무단전재-재배포 금지